Нашумевшая модель Kandinsky обновилась до версии 2.0, новая версия уже на ML Space

Летом 2022 разработчики представили широкой публике модель для генерации изображений на основе текстового описания Kandinsky. Сейчас маркетплейс AI Services, доступный через платформу ML Space, пополнился обновленной версией нейрохудожника — Kandinsky 2.0. Модель научилась качественно обрабатывать запросы на 101 языке, дорисовывать недостающие части картинки и создавать арты в разных стилях.

Выход Kandinsky 2.0 анонсировали на международной конференции по искусственному интеллекту (ИИ) Artificial Intelligence Journey как первую российскую мультиязычную диффузионную модель, содержащую 2 млрд параметров.

Традиционно для задач генерации используются авторегрессионные (как в случае с предшественником модели) и GAN-подобные архитектуры сетей. Однако такие модели на выходе обладают рядом недостатков, например, требуют сложного подбора гиперпараметров и страдают нестабильностью обучения. На этот раз разработчики решили воспользоваться набирающим популярность диффузионным подходом, хорошо зарекомендовавшим себя в вопросах генерации мультимедийного контента.

Непосредственное обучение модели проходило на платформе ML Space. Процесс занял 2 недели или 65 856 GPU-часов.

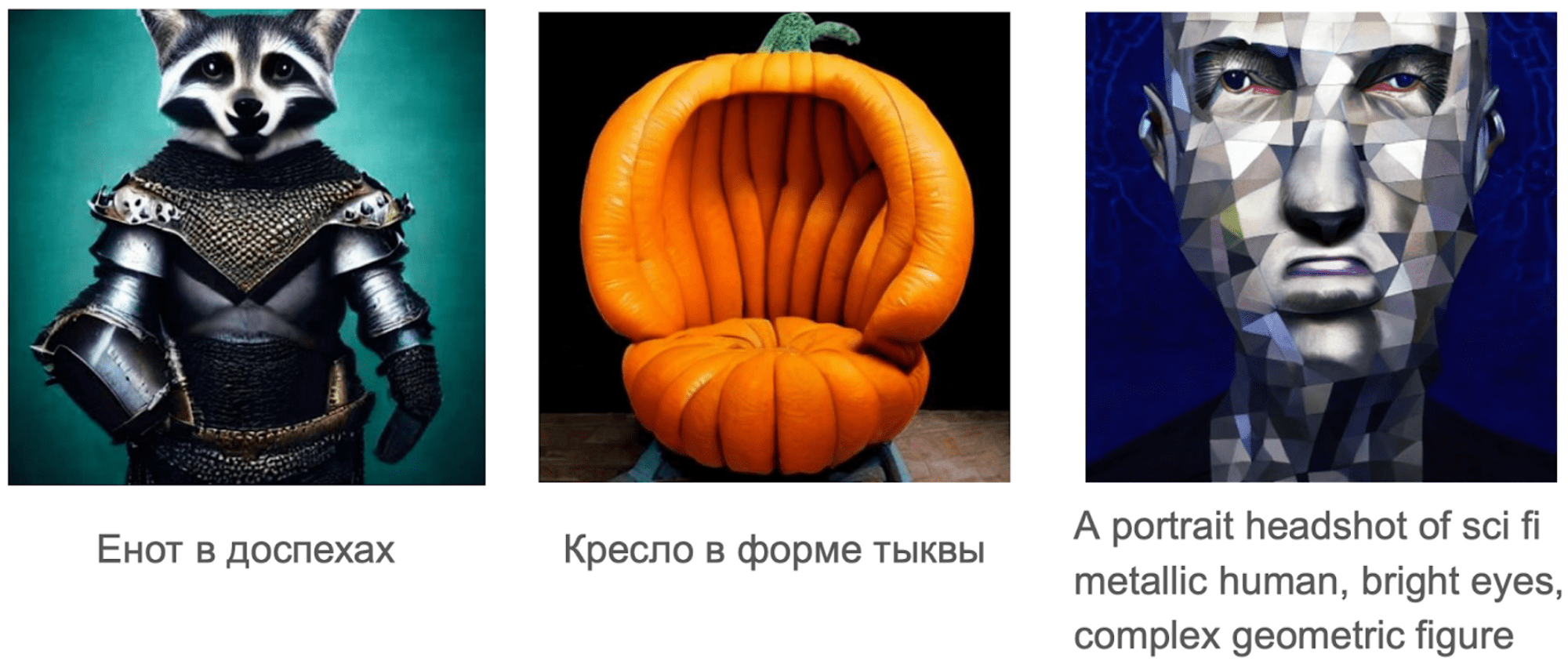

Kandinsky 2.0 генерирует более насыщенные и детализированные образы, а также предоставляет пользователям дополнительные возможности: например, замену любой части изображения на фрагмент сгенерированный нейросетью или возможность дорисовать неполную картинку.

Протестировать возможности нейросети можно на портале FusionBrain, там же реализована возможность сгенерировать изображения в 20 различных стилях от мультипликации до хохломы. Также пользователи могут оценить, как идентичные по сути лингвистические конструкции дают неожиданный результат в зависимости от языка. Например, если сформулировать запрос «самое известное животное в дикой природе» на русском языке, нейросеть нарисует тигра, а на испанском это будет альпака.